Qzone

Qzone

微博

微博

微信

微信

“自从养了虾,我的钱包好‘痛’!”“让它帮我写个代码,能烧掉几千块。”“Token怎么又涨价了?有没有能薅的羊毛?”

自从“全民养虾”掀起新一轮热潮以来,除了看热闹、尝尝鲜的普通用户,“养虾人”很快发现,随着交付给Agent的工作量和工作难度提升,Token消耗的飞快,带来巨大的成本压力。更别提政企用户,想要规模化“养虾”,选择公有云调用面临着“越用越贵”的局面。此外,在上游内存等硬件涨价的背景下,大部分公有云供应商被迫集体涨价,又进一步推高了Agent落地的算力成本。

这揭示了当下政企“养虾”的资源痛点。因此,从算力基础设施、工程化能力等方面入手,提高算力供给的“量”与“质”,让政企既能享受媲美公有云的澎湃算力,又能兼顾私有云的数据安全合规,成为加速政企数智化转型的重要手段。

要“养虾”,算力成本可能超出想象

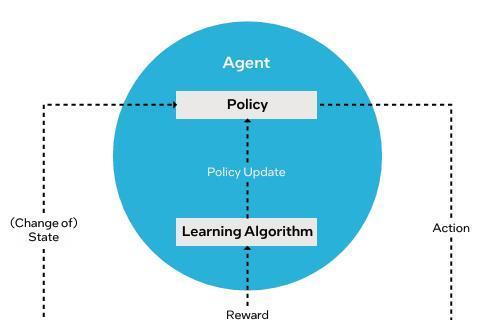

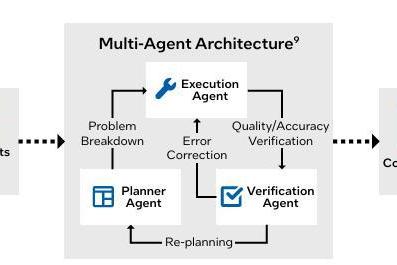

当前市面上Claw类应用层出不穷,其共性特点是一个持续运行、自主思考、反复调用模型的智能体,普通AI是“问一次、答一次”,Claw是“想一步、做一步、检查一步、再想下一步”,一个任务可能触发几十次API调用,每次调用又和上下文长度、任务复杂度挂钩,使得token消耗量倍增。

而政企用户部署Claw类应用,显然不满足于让它扮演“聊天机器人”,而是要深入业务场景,处理海量的业务数据并作出决策,其执行过程更加复杂;因此,相比普通用户,政企用户的token用量更加巨大,每天消耗Token数量可达从万级甚至十万级。某高校将OpenClaw部署到教学场景仅两周,tokens消耗量就激增近百倍,不得不扩容10倍算力才能跟上需求。

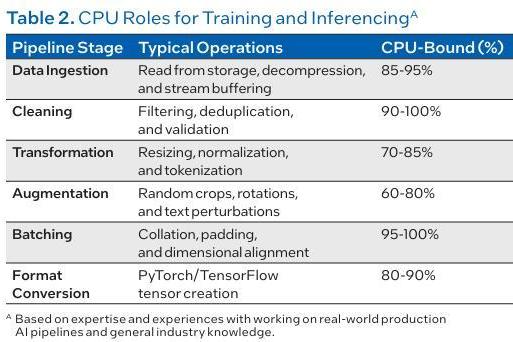

此外,政企用户会要求Claw类应用 “时刻待命,随时开工”;龙虾“待命”时,CPU通用算力处于闲置状态,而一旦“开工”,CPU算力又会快速进入波峰,呈现巨大的波动特征,但平均下来CPU负载仅为5%,严重影响算力资源的整体使用效率。换言之,如果没有高效的算力调度能力,政企自购自建的算力资源未必能百分百地用在刀刃上。

公私兼顾,混合云成“养虾”更优解

以上可见,解决算力资源痛点不仅需要“开源”还要“节流”,在底层算力技术、工程化能力、大模型推理优化等方面切入,通过提升算力资源利用率来放大投入收益。因此,政企用户开始追求能让自己“高效”养虾的底座,以合理成本完成智能化转型。而混合云在资源高效利用方面的特性,以及兼具性能、安全、运营的优势,使其成为政企“养虾”的更优选择。

从各大厂商推出的混合云养虾方案来看,主要通过智能化手段,实现对算力资源的自动化调度,包括动态负载感知、算力弹性伸缩、模型切分部署等技术。这里以华为混合云推出的Claw方案为例:

其一是动态负载感知:通过Flexus云服务器负载感知建模能力,动态识别Claw类应用的闲置时间,实现自动“错峰”,智能化调度算力资源,将主机利用率从15%升至30%,以提升政企资源投入的成本效益;

其二是引入智能算力弹性伸缩:针对模型推理调用的潮汐特征,通过自动扩缩容插件和云原生资源插件,实现弹性扩容、按需使用,动态优化NPU、GPU、CPU等资源的供给,保证推理服务质量与资源利用率的平衡;

其三是引入PD分离与大规模专家并行部署:将大模型推理的Prefill(预填充) 和Decode(解码)两个关键阶段分离部署,同时将模型中的多个“专家”模块切分部署、并行处理,彼此实现最佳优化效果,满足时延要求和吞吐要求,大幅提升整体性能。

此外,随着Agent时代到来,AI消费模式也在不断变化,相比公有云按量计费模式,混合云的一次性买断模式更显成本优势。有政企客户算了一笔账:按100个OpenClaw实例,月均消耗100亿Token计算,在公有云按量计费模式下,1年成本高达264万元;对长期使用的政企客户而言,线下部署一次性买断显然更加经济划算。

由此可见,政企全面拥抱Claw类应用,既要综合考虑性能和安全,也要兼顾成本和效益。而华为混合云通过底层技术和工程化能力,结合买断制商业模式,持续放大算力资源的利用率,逐渐受到政企用户的青睐,为“全民养虾”深入到“政企养虾”提供了一条高效率、高性能、高性价比的最优路径。